Facebook暗黑启示录: 你每天在想啥,算法“说了算”

人生的悲和喜,早就被社交媒体的算法所注定了。

抖音、微博、Soul、小红书...这些社交媒体是不少人的“心头好”,其包罗万象的丰富内容和打破地域、时间限制的社交属性,让不少人大呼“刷的停不下来”。以至于从赛博空间和现实空间中的来回穿梭,成为了每个人再熟悉不过的“日常”。

但这个十月,作为全球最大的社交媒体——Facebook(脸书),却因为让用户“刷上瘾”,摊上大事儿了。搞不好,全球社交媒体真有可能迎来“巨变”。

社交媒体巨头遇上了“吹哨人”

自9月份以来,在全球坐拥30亿月活跃用户的Facebook,就不断受到“泄密”的困扰,美国知名主流媒体WSJ一直在爆关于Facebook的“黑料”,例如其算法如何增加社会矛盾、犯罪分子如何公开使用其服务以及其产品对年轻女性的心理健康影响等等。很明显,WSJ获得了Facebook内部人员的帮助,因为许多“黑料”只有员工才知晓。

就在Facebook还在苦苦追查“内奸”的时候,没想到,这个人居然跳出来“自爆身份”了。

当地时间10月4日,作为Facebook的“公民诚信委员会”部门的前雇员——Frances Haugen接受了媒体《60分钟》的采访,坦言其在离职之前复制了上万页Facebook的内部资料,并向媒体和政府部门做了提交。这是因为,她认为有充足的证据表明:Facebook在反对仇恨、暴力和错误信息方面,正在对公众撒谎。

而几天后,她在美国国会作证的言辞更加犀利与激烈。Haugen表示,Facebook旗下的产品为了达到让用户“上瘾”的目的,不惜以伤害儿童、煽动群体撕裂、削弱民主进程为代价。而公司领导层在巨大的利益面前,明知如何能让产品更安全,但仍然无动于衷。

如果用大白话来说,就是Facebook的将旗下产品所包含的算法故意设置成:不断向用户推送带有仇恨、矛盾争端类的内容,以期让用户消耗更多的时间和精力在Facebook的各项产品上,这样就可以赚到更多的钱。至于用户看了这些内容后,其生活和价值观会受到哪些影响,Facebook就不管了。

镁客网注意到,对这起事件,不少美国主流媒体都使用了吹哨人(Whistleblower)一词来形容本次事件的爆料人Frances Haugen。而在英语语境中,该词一般有着“为使公众注意到政府或企业的弊端,以采取某种纠正行动的人”的正面含义。可见在美国主流舆论中,已经举起了“反Facebook”的大旗。

不过,换个角度来说,Facebook所面临的算法问题,怕是世界上没有哪家社交媒体敢表态“独善其身”。那么,算法对于社交媒体来说,是必不可少的吗?又真的有影响人喜怒哀乐、行为乃至价值观的强大能力吗?

你可能不懂算法,但算法“懂你”

一般来说,算法所指的是:一组基于某种指定计算,将输入数据转换为所需输出的编码过程。

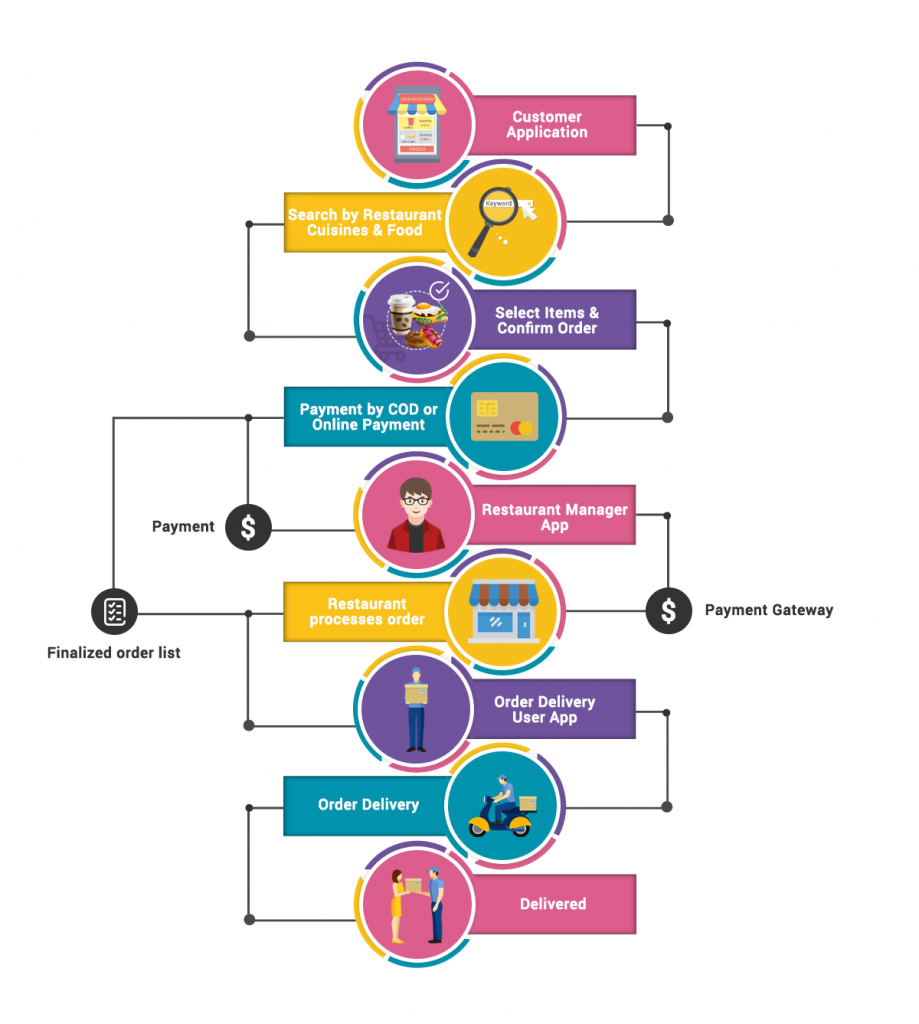

有点玄是不?浅显地说,就和你在点外卖时,输入“黄焖鸡”后,系统自动跳出来一系列关于黄焖鸡的内容,是一个道理。

基于你的“黄焖鸡”这个输入数据,系统反馈给你一系列关于“黄焖鸡”的单品、门店甚至评价。而究竟是哪些内容、以何种排序方式来体现在你面前,就是算法的工作了。

一般来说,外卖系统会根据距离、评价、你过去的点餐记录、优惠及商家付费推广情况等等数据,来作为评判依据,最终把评判后认为最适合你的内容推送给你。

为什么要这么做呢?

这是因为:第一,可选的内容太多,算法要为你做出筛选,便于你做出选择。如果你的配送范围内只有3家店有这种菜,自然没有什么可“算”的。但往往菜品都是重复的,在你周围上百家店可能都能提供同质化的服务,这时候筛选出“优质的”,就成为必要的了。

第二,平台希望能促成交易。你可能注意到,如果某家店你反复看过几次,或者某家店在做商业推广,那么在下一次打开外卖服务时,这家店保准在推荐的前排,这就是算法在判断和推动你和这家店来达成交易。某种意义上,你每天做出决定自己吃啥,也不完全是自己的意愿,而是无形中受到了平台算法的影响。

回到我们的社交媒体上,其实是同样的道理。社交媒体平台知道,你希望找到自己爱看的、感兴趣的内容,平台也希望能够快速筛选出他们认为“适合你”的内容,从而长期的让你消耗精力和时间在产品上,这样他们才可以赚到更多的广告等费用。

所以,这就是为什么随便打开一个社交媒体,他们的推荐内容都可以很快抓住你的注意力,让你不知不觉的“刷完”一个晚上的时间——算法“懂你”了。

如果仅仅是如此,也就罢了,毕竟大家各取所需。可是社交媒体也是媒体,其自带的天然属性,这时候就发挥作用了。

你每天在想啥,算法“说了算”

如果说传统媒体有哪些自带“天赋”,“议程设置”绝对是其中的一项。

早在20世纪20年代,以报纸、广播为代表的大众媒体正发展得如火如荼,给社会带来便利的同时也产生了不良影响,引起了不少学者对大众媒体能力的反思。在这一时期美国著名新闻评论家李普曼就在其影响深远的《舆论》(Public Opinion)一书中抛出了“新闻媒介影响‘我们头脑中的图像’”这一说法。算是早期“议程设置”理论的雏形。他认为,大众媒体就好像黑暗中的“探照灯”,人们只能顺从地去看到被其“照亮”的那一小块区域,而忽视了其余的部分。

而1963年学者伯纳德·科恩(Bernard Cohen)对“议程设置”的表述则更为清晰有力:媒体无法决定你怎么想,但能成功地决定让你去想哪些东西("the press may not be successful much of the time in telling people what to think, but it is stunningly successful in telling its readers what to think about" )。

随后1972年,马尔科姆·麦肯姆斯(Maxwell McCombs)和唐纳德·肖(Donald Shaw)进一步用实证研究的方法验证李普曼的思想,并贡献了《大众传播的议程设置功能》这一论文,从此“议程设置”成为了传播学中的一个经典理论:大众媒介对新闻事件的选择性呈现,影响了人们的“视野”;同时,人们根据大众媒介对问题的重视程度,来确定自己的关注程度。

这种“议程设置”的能力赋予了传统媒体可以影响社会舆论、关注点的“魔法棒”,从而在一个多世纪的时间里,传统媒体都在对政治、经济等方面产生着巨大的影响。

而随着新媒体技术的发展,传统媒体逐渐式微,自媒体兴起,“人人都有麦克风”的时代让人类不得不面对信息“爆炸式增长”、“超载”和“虚假”等问题。作为承载自媒体的社交媒体平台,不得不采用算法来进行筛选、推荐内容等工作。从而,“议程设置”这个魔法棒,也就自然交到了平台手中。

然而,在商业等需求的驱使下,真正决定你每天在社交媒体上看到什么的算法,实际上并没有“只选出你可能喜欢的”那么纯粹,而是掺杂了平台自身利益诉求的“混合算法”。

回到Facebook的这起“吹哨人”事件上来,作为爆料者的Frances Haugen就是因为看不下去公司的“要钱不要底线”、在“唯流量论”的指引下,宁可让对用户影响恶劣的内容发出来,也要保持利润的做法,这才上演了一场堪称商业版“棱镜门”的好戏。

公共领域online,或许只是个乌托邦式的幻想

当代哲学家哈贝马斯(Jürgen Habermas)曾提出了充满理想色彩的“公共领域”(public sphere)这一概念。在他看来,西方社会中应该有“公共领域”这一方天地,作为国家和社会的中间地带,来让那些理性公民可以自由的表达各自的成熟观点,从而推动社会和国家的民主进步。

在进入新媒体时代后,有人把这套学说的希望给予在了社交媒体之上,毕竟数字社会才是世界的未来。

但以Facebook此次的“吹哨人”事件来看,暴力、仇恨等内容并非平台自己生产的,而是用户自己生产并传播的,Facebook的“恶”在于不仅放松了管制,并且还出于自身的商业利益来推波助澜。

这说明,目前互联网仍是鱼龙混杂的状态,并不是每个人在发言时都以一个成熟理性的公民的角色;而作为“领域”提供者的Facebook,如果没有一个合理公正的算法,又怎么能筛选出合理优质的信息呢?

当然,必须要理解的是,在当前的客观条件下,想做出一套满足最大社会价值取向的算法,本身仍还是一个理想。而作为全球最大社交媒体的Facebook做不到,其它各个国家的自媒体平台,怕也是不太容易成功。

所以,“公共领域”的online版,或许只是个乌托邦式的幻想,社交媒体仍然只是展示现实世界的一个“井口”。当你我随着“刷刷刷”而大喜大悲的时候,冷静一下,现实大概并不是你在小小屏幕上所看到的那样。

作者:毛毛

最新活动更多

-

10 阿里AI需要算一笔账了

- 1 GPT-6要来了,但AI行业早不跟 OpenAI玩了

- 2 火爆的“Token经济学”,关乎你的钱包、职场和未来消费 | 人人能懂的产业报告

- 3 资本巨头纷纷抽身,为何中小投资者仍为AI狂热加码?

- 4 大厂财报中的AI图鉴:营收单列、玩杠杆、商业画饼

- 5 从百度到Meta,科技巨头的 AI 组织战,开打了

- 6 宇树科技招股书透视:中外具身智能玩家生存竞速

- 7 2026年3月,国内具身智能机器人企业融资汇总

- 8 华勤财报发布:收入规模破1700亿,利润增长近40%

- 9 谷歌Gemma 4遭破解!实测:伪造支票、找盗版电影,有求必应

- 10 大涨30%!智谱 AI 财报出炉:营收暴增132%,API 增长3倍,市值破 4000 亿

分享

分享

发表评论

登录

手机

验证码

手机/邮箱/用户名

密码

立即登录即可访问所有OFweek服务

还不是会员?免费注册

忘记密码其他方式

请输入评论内容...

请输入评论/评论长度6~500个字

暂无评论

暂无评论