神经网络1:多层感知器-MLP

神经网络是当前机器学习领域普遍所应用的,例如可利用神经网络进行图像识别、语音识别等,从而将其拓展应用于自动驾驶汽车。它是一种高度并行的信息处理系统,具有很强的自适应学习能力,不依赖于研究对象的数学模型,对被控对象的的系统参数变化及外界干扰有很好的鲁棒性,能处理复杂的多输入、多输出非线性系统,神经网络要解决的基本问题是分类问题。

目前在机器学习领域火爆的开源软件库中,TensorFlow算其中一个,里面有大量的机器学习和深度神经网络方面的研究,毕竟由Google 大脑小组开发出来,其系统的通用性和易用性是无可比拟的,TensorFlow是一个采用数据流图(Data flow graphs),用于数值计算的开源软件库。节点(Nodes)在图中表示数学操作,图中的线(edges)则表示在节点间相互联系的多维数据数组,即张量(tensor)。(数据流图用“结点”(nodes)和“线”(edges)的有向图来描述数学计算。“节点”一般用来表示施加的数学操作,但也可以表示数据输入(feedin)的起点/输出(push out)的终点,或者是读取/写入持久变量(persistent variable)的终点。“线”表示“节点”之间的输入/输出关系。这些数据“线”可以输运“size可动态调整”的多维数据数组,即“张量”(tensor)。张量从图中流过的直观图像是这个工具取名为“Tensorflow”的原因,一旦输入端的所有张量准备好,节点将被分配到各种计算设备完成异步并行地执行运算)。因此对想快速上手神经网络做一些有趣的图像识别和语音识别的小伙伴可利用TensorFlow进行学习。

神经网络的变种目前有很多,如误差反向传播(Back Propagation,BP)神经网路、概率神经网络、卷积神经网络(Convolutional Neural Network ,CNN-适用于图像识别)、时间递归神经网络(Long short-term Memory Network ,LSTM-适用于语音识别)等。但最简单且原汁原味的神经网络则是多层感知器(Muti-Layer Perception ,MLP),只有理解经典的原版,才能更好的去理解功能更加强大的现代变种。

MLP神经网络的结构和原理

理解神经网络主要包括两大内容,一是神经网络的结构,其次则是神经网络的训练和学习,其就好比我们的大脑结构是怎么构成的,而基于该组成我们又是怎样去学习和识别不同事物的,这次楼主主要讲解第一部分,而训练和学习则放到后续更新中。

神经网络其实是对生物神经元的模拟和简化,生物神经元由树突、细胞体、轴突等部分组成。树突是细胞体的输入端,其接受四周的神经冲动;轴突是细胞体的输出端,其发挥传递神经冲动给其他神经元的作用,生物神经元具有兴奋和抑制两种状态,当接受的刺激高于一定阈值时,则会进入兴奋状态并将神经冲动由轴突传出,反之则没有神经冲动。

我们基于生物神经元模型可得到多层感知器MLP的基本结构,最典型的MLP包括包括三层:输入层、隐层和输出层,MLP神经网络不同层之间是全连接的(全连接的意思就是:上一层的任何一个神经元与下一层的所有神经元都有连接)。

由此可知,神经网络主要有三个基本要素:权重、偏置和激活函数。

权重:神经元之间的连接强度由权重表示,权重的大小表示可能性的大小

偏置:偏置的设置是为了正确分类样本,是模型中一个重要的参数,即保证通过输入算出的输出值不能随便激活。

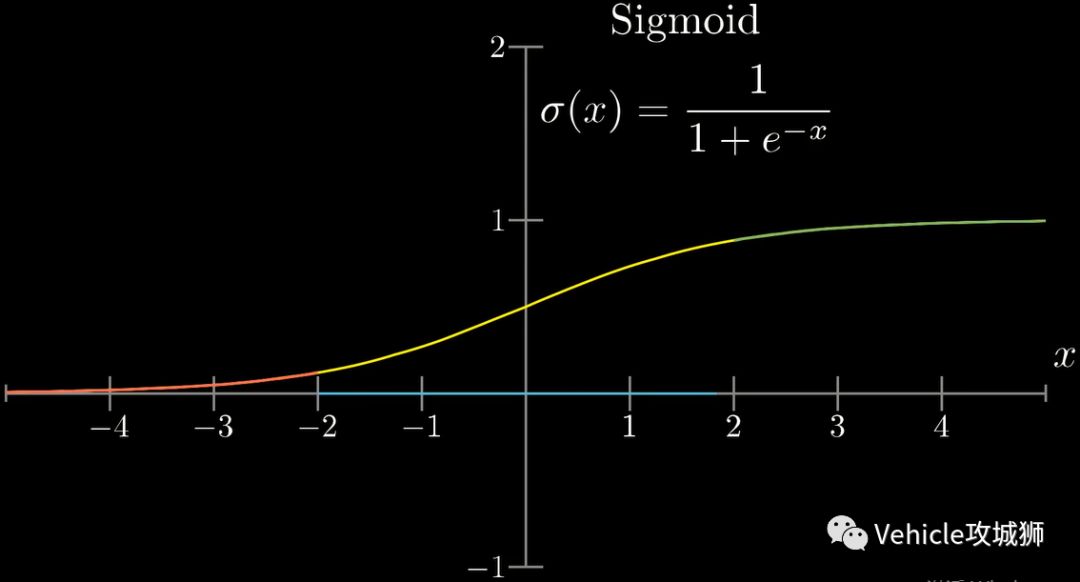

激活函数:起非线性映射的作用,其可将神经元的输出幅度限制在一定范围内,一般限制在(-1~1)或(0~1)之间。最常用的激活函数是Sigmoid函数,其可将(-∞,+∞)的数映射到(0~1)的范围内。

激活函数还有tanh和ReLU等函数,tanh是Sigmoid函数的变形,tanh的均值是0,在实际应用中有比Sigmoid更好的效果;ReLU是近来比较流行的激活函数,当输入信号小于0时,输出为0;当输入信号大于0时,输出等于输入;具体采用哪种激活函数需视具体情况定。

从上面可知下层单个神经元的值与上层所有输入之间的关系可通过如下方式表示,其它以此类推。

MLP的最经典例子就是数字识别,即我们随便给出一张上面写有数字的图片并作为输入,由它最终给出图片上的数字到底是几。

对于一张写有数字的图片,我们可将其分解为由28*28=784个像素点构成,每个像素点的值在(0~1)之间,其表示灰度值,值越大该像素点则越亮,越低则越暗,以此表达图片上的数字并将这786个像素点作为神经网络的输入。

而输出则由十个神经元构成,分别表示(0~9)这十个数字,这十个神经元的值也是在(0~1)之间,也表示灰度值,但神经元值越大表示从输入经判断后是该数字的可能性越大。

隐层的层数和神经元的选择需根据具体情况选择,此例选择两层隐层,每层16个神经元。那么根据上面的叙述,根据权重、偏置的个数此神经网络将会有13002个参数需要去调节,而如何调整这些参数,从而使神经网络有较好的学习效果则正是下篇更新的神经网络训练和学习的内容。

通过楼主上面的叙述,该图像识别问题最终可通过线性方程的方式表示出来,从而来描述本篇通过MLP神经网络进行数字识别的案例,并通过建立的问题描述模型来编程实现。

总结

MLP神经网络的结构还是挺简单的,基本的结构和原理是入门学习所必须了解的。神经网络训练和学习这块等楼主有机会再更新,发现前期给自己挖太多坑都还没填,主要在于楼主忙于工作,最近正好是2019上海车展,楼主也去转了一波,基本都待在二层的零部件供应商那里,了解下各大供应商在智能出行、电驱、智能网联等方面的系统集成和解决方案,收获还是很多的,也希望能在下篇跟大家做个分享。

- END -

图片新闻

最新活动更多

-

5月13日立即预约>>> 【线下会议】恩智浦创新技术峰会·深圳

-

精彩回顾立即查看>> 【在线直播】可视化神器!VisionSym 赋能汽车光学原型开发

-

精彩回顾立即查看>> 12月16-17日 AMD 嵌入式峰会

-

精彩回顾立即查看>> 恩智浦创新技术峰会

-

精彩回顾立即查看>> 【工程师系列】汽车电子技术在线大会

-

精彩回顾立即查看>> Works With 开发者大会深圳站

推荐专题

- 1 改写出行格局!充换电基建的五年蝶变

- 2 纯视觉遭调查 特斯拉自动驾驶遇生死考验

- 3 北京在全国首推“智驾险”,各车企智驾水平要“露底”?

- 4 VLA 与世界模型之争:谁才是辅助驾驶的正确方向?

- 5 卖芯片还是卖平台?地平线与黑芝麻智能悄然走出分水岭

- 6 2026 百人会论坛:地平线|推舱驾融合的“智能体芯片”

- 7 「武汉萝卜快跑」事件背后:有时停下是为了更快的奔跑

- 8 为啥有人认为自动驾驶纯视觉方案比激光雷达方案好?

- 9 中国自动驾驶Robotaxi围攻中东【附投票】:曹操出行、文远知行、小马智行、萝卜快跑四路诸侯,谁才是真正的“沙漠之狐”?

- 10 2026百人会论坛:卓驭科技|从智驾到物理AI,沈劭劼说这是生存判断不是战略判断

分享

分享

发表评论

登录

手机

验证码

手机/邮箱/用户名

密码

立即登录即可访问所有OFweek服务

还不是会员?免费注册

忘记密码其他方式

请输入评论内容...

请输入评论/评论长度6~500个字

暂无评论

暂无评论